SceneScout — исследовательский проект Apple и Колумбийского университета, призванный помочь незрячим и слабовидящим людям ориентироваться в пространстве. Для этого были объединены возможности Apple Maps и GPT-4o. Пользователи могут не только получать пошаговые инструкции и ориентиры, но буквально исследовать весь маршрут квартал за кварталом.

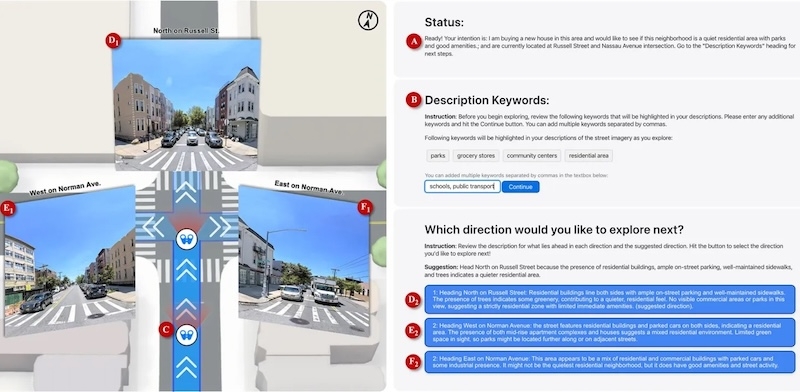

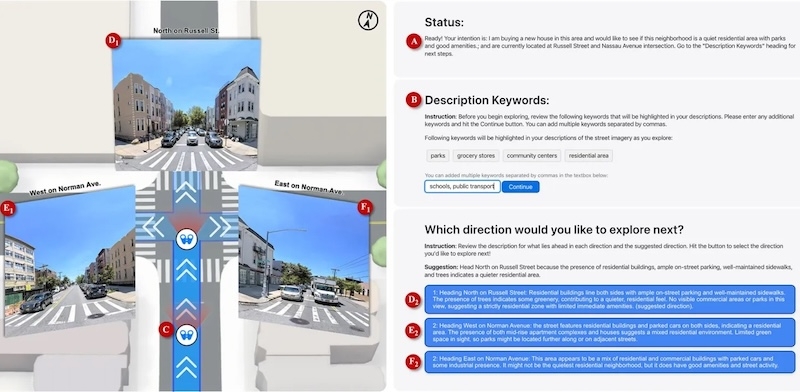

Система предлагает два режима. Route Preview даёт представление о том, что человек встретит на своём пути: рассказывает о препятствиях на тротуаре, наличии перекрёстков, различных визуальных ориентирах. В режиме Virtual Exploration пользователь сообщает, что он ищет (например, «тихий жилой район с парками»), а ИИ на основе запроса шаг за шагом проводит его в нужное место.

SceneScout ориентируется на карты Apple Maps и имитирует поле зрения пешехода. Система интерпретирует то, что «видит», и подготавливает структурированный текст, разбитый на короткие, средние или длинные описания.

Например, система может сообщить: «Перед зданием припаркованы автомобили. Уличные знаки указывают, что это улица Фигероа. Справа вы найдёте Bank of America». Или: «Здесь широкие тротуары с деревьями и несколькими магазинами. Также видны надземные переходы, соединяющие здания над улицей».

Первые испытания, в которых участвовали 10 человек с нарушением зрения, показали многообещающие результаты. Участники высоко оценили полезность сервиса и особенно отметили режим Virtual Exploration.

Однако не обошлось без недостатков. Некоторые подсказки содержали неточности — например, неверную маркировку дорожных знаков или устаревшие данные о строительных работах и припаркованном транспорте.

Говорить о внедрении SceneScout пока рано. Главная задача проекта — исследовать взаимодействие между API Apple Maps и многомодальной большой языковой моделью.